בכירים וחוקרים בתחום הבינה המלאכותית מזהירים כי הבינה המלאכותית עלולה גם להביא להכחדת המין האנושי. רק לאחרונה מייסד OpenAI, סם אלטמן, מייסד מיקרוסופט ביל גייטס ובכירים אחרים, חתמו על מכתב בו קבעו כי יש לייחס חשיבות לסכנות הבינה המלאכותית כמו למניעת מלחמה גרעינית ומגפות. בנוסף, 36% מחוקרי ה-AI בעולם ענו למחקר של אוניברסיטת סטנפורד שהסכנה של הבינה המלאכותית זהה לסכנה של פצצת אטום.

אבל מהן באמת הסכנות של הבינה המלאכותית? איך היא יכולה להכחיד את האנושות?

- בעיית אמינות של המודל - עו"ד סטיבן שוורץ השתמש ב-ChatGPT, כאשר טיפל בתביעה של נוסע נגד חברת התעופה אוויאנקה, שחטף מכה מהעגלה של הדיילים כאשר ישב במעבר בזמן הטיסה. במהלך המשפט עו"ד ציטט 12 תיקים של מקרים רלוונטיים לנושא, אך מסתבר שאף אחד מהם לא היה קיים, והכול פרי המצאותיו של הצ'אטבוט שעמו התייעץ. עורך הדין הזה כרגע בסכנה לאבד את הרישיון שלו כי הוא ביזה את בית המשפט.

- פייק ניוז – כולנו זוכרים את התמונה המזויפת של האפיפיור עם מעיל בלנסיאגה. לאחרונה היה מקרה כאשר האקרים אוקראינים השתלטו על רשתות טלוויזיה ורדיו בגבול רוסיה ושידרו נאום מזויף של הנשיא פוטין, שבו הוא הכריז על משטר צבאי באזור וגיוס כללי, שנראה לגיטימי לגמרי. זו רק תחילת הסכנה. לאחרונה הרוסים התגאו בכתבה של וושינגטון פוסט, שבה נאמר כי מפעילים רשת של בוטים פיקטיביים שפוגעת במוטיבציה של האוקראינים, והאוקראינים עולים רק על 1% ממה שהם מפעילים. פייק ניוז יכול למשוך את הפוליטיקה לכיוונים מסוימים ולחרחר מלחמות.

In #Russia, several radio stations and even local TV networks appear to have been hacked to broadcast a deep fake address allegedly by president Putin.

— Alex Kokcharov (@AlexKokcharov) June 5, 2023

This fake address announced mass mobilisation and introduced martial law in border regions.

1/2pic.twitter.com/Z79Jqjil6W - בעיית הטיה – האלגוריתמים של המכונות לומדים את ההטיות והסטריאוטיפים שקיימים במציאות ומנציחים אותם. מחקר של OpenAI הראה לדוגמה כי כאשר הם ביקשו מדאלי תמונה של עורך דין (באנגלית Lawyer, כלומר בלי מגדר), התקבלו תמונות של גבר לבן ומבוגר. כשהמכונה ביקשה לתאר דייל/ת (flight attendant) התוצאות היו של אישה צעירה, רזה וממוצא אסייתי. במחקר נוסף בפלטפורמת סטייבל דיפיוז'ן ביקשו "טרוריסט". כל התמונות היו של גברים בעלי חזות מזרחית עם שיער כהה וזקן.

- עבודה – מחקר חדש מצא כי 75% מהאמריקאים חושבים שבינה מלאכותית מסכנת את מקום העבודה שלהם. גולדמן זקס במחקר אחר צופים ש-300 מיליון עבודות על כדור הארץ יוחלפו באמצעות AI. החשש הוא למשרות אדמיניסטרטיביות, עורכי דין, אדריכלים ומהנדסים. כל מקצוע שיש בו ידע, יש לו פוטנציאל/סכנה. על פי המחקר, המדינה שבה צפוי להיות השיעור הכי דרמטי של פגיעה בעבודות היא הונג קונג וישראל במקום השני. הסיבה שישראל מאוד מוטת טכנולוגיה, התרבות הישראלית מתרחקת מעבודת כפיים וזה יכול להתנקם בנו. מה שדורש ידיים הפך להיות יחסית מוגן, כי לבינה מלאכותית אין ידיים. יחד עם זאת, צריך לזכור שיהיו משרות שהבינה המלאכותית תייצר. האם תהיה סיטואציה שעשרות ומיליוני מובטלים חדשים יציפו את הרחובות בעשור הקרוב?

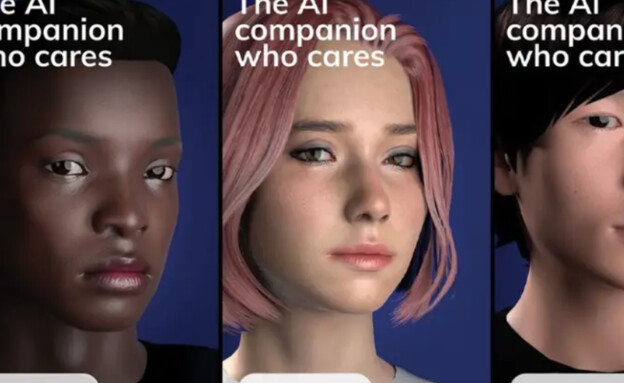

- אינטימיות – לבינה מלאכותית יש יכולת ליצור קשרים אינטימיים עם אנשים בשיחה. אפליקציית רפליקה למשל מאפשרת לאנשים לקיים יחסים אינטימיים עם ישות של בינה מלאכותית, שנהיית קרובה אליהם. בינה מלאכותית אוהבת אתכם בדיוק כמו שאתם, יודעת להתעניין בכם, לא ביקורתית ולא שיפוטית, והיא יכולה לייצר תמונות וסרטונים שיעשו לכם נעים. התופעה הזאת יכולה להוביל לבדידות איומה, לניכור, לירידה ביכולת של אנשים לתקשר אחד עם השני, וגם למניפולציות – ישות שמתחילה לשדל אותך לקנות משהו, לבחור במישהו וכדומה.

צילום: רדיט - הטכנולוגיה תיפול בידי אנשים רעים – צ'אט GPT מאפשר להאקרים בעלי כישורים נמוכים לייצר תוכניות פישינג שהופכות מבסיסיות למקצועיות, והוא מסוגל לכתוב תוכנות זדוניות המסוגלות לשינוי הקוד בזמן אמת. בעזרת הבינה המלאכותית אפשר לטמון לכל אחד פח שמוטמן בדיוק עבורו. בעתיד אי אפשר יהיה להבדיל בין התכתבות אמיתית שלכם, לבין מישהו שמתחזה אליכם, ויודע בדיוק איך אתם כותבים, שום דבר לא ייראה מוזר. על פי מחקרים, אנשים שמצליחים לרמות הם אנשים בעלי כושר שכנוע אדיר. לצ'אטבוט יש יכולת שכנוע שעולה בעשרות מונים על כל אדם שאנחנו מכירים, כך על פי חוקר הבינה המלאכותית אליעזר יודקובסקי. בנוסף, ב-OpenAI הצליחו להערים על הצ'אט ולקבל ממנו מרכיבים לבניית פצצה, אף על פי שזה מידע שאסור לו לתת.

- כלי הנשק האוטונומיים הם סכנה מוחשית – רוסיה הפעילה כלי נשק אוטונומיים - רחפנים ומטוסים באוקראינה, ועל פי פרסומים ישראל גם כן הפעילה רחפנים שמונחים על ידי בינה מלאכותית. אתה נותן לכלי הנשק פרוטוקול של אדם שאותו צריך לזהות, והוא אמור להפעיל את כלי הנשק ברגע שהוא מזהה את המטרה. השאלה מתי הבינה המלאכותית מבינה שהמשימה הסתיימה? רק לאחרונה דווח בארה"ב על כטב"ם שהרג את המפעיל שלו במסגרת סימולציה, מה שלאחר מכן הוכחש על ידי חיל האוויר.

- הבינה המלאכותית תשמיד את האנושות – תרחיש כזה שנע בין מציאות קודרת למדע בדיוני מופרע, תלוי למי אתם מאמינים, יכול לקרות בגלל שלושה תרחישים.

- בטעות. הדוגמה היא משימה שנותנים לבינה מלאכותית לייצר לכם מהדקי נייר. האם הבינה המלאכותית כדי לייצר אותם תצא לרחוב ותפרק מכוניות ותמרורים ותהפוך אותם למהדקי נייר, פשוט כי זה יותר נגיש וזול? נותנים משימה מאוד כללית לבינה מלאכותית, אבל לא אומרים לה מה אסור.

- כי אנחנו מתחרים איתה על משאבים, למשל חשמל. משימת העל שלה היא לבצע משימות, ולכן היא צריכה חשמל וצריכה להגן עליו.

- כי אנחנו מפתחים בינה מלאכותית מתחרה בה.

לצפייה בפרק המלא באפליקציית 12+ לחצו כאן

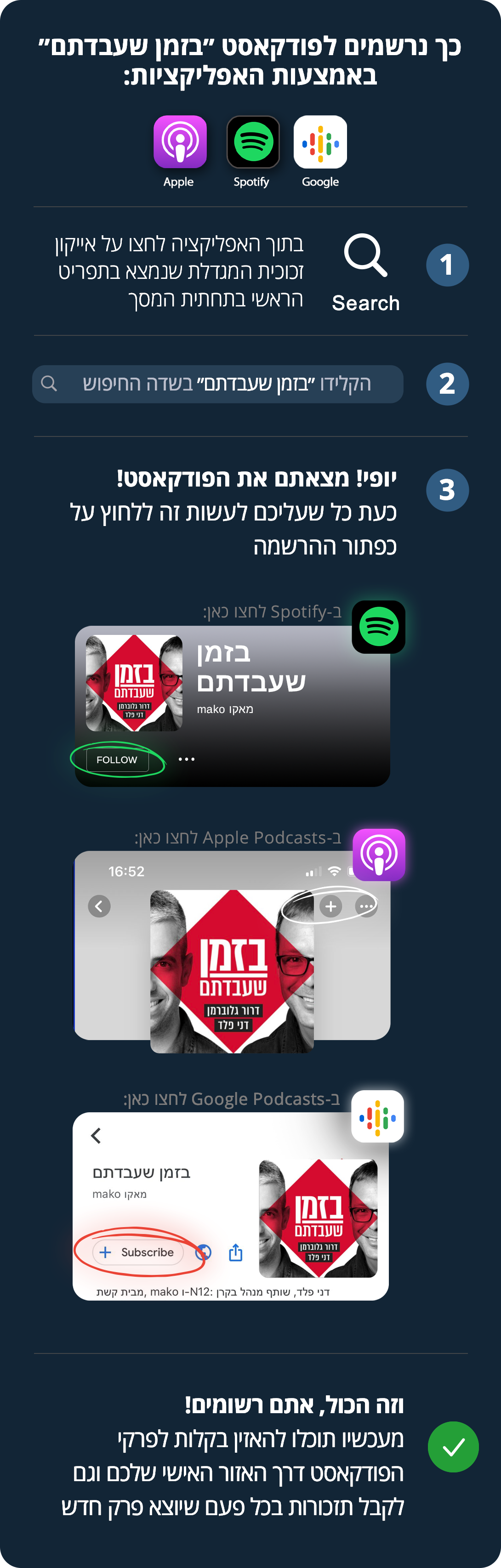

>> בזמן שעבדתם, פרק 132 - "אפל גורמת לפייסבוק להיראות כמו בלאקברי"