דווקא בתקופה החשוכה שישראל חווה בימים אלו, אפשר לראות ניצוצות של אור בדמות סיפורי הצלחה של סטארטאפים ויזמים ישראליים. סיפור ההצלחה הגדול של התקופה האחרונה שייך לאיליה סוצקבר, ישראלי לשעבר שגייס מיליארד דולר, כשיש בחברה שלו 10 עובדים בלבד.

ב-2015 סוצקבר היה שותף להקמת חברת OpenAI יחד עם אילון מאסק, והוא שימש בה כמדען הראשי. ניתן לומר שסוצקבר וסם אלטמן, מנכ"ל החברה, מפוצלים אידיאולוגית: סוצקבר רוצה לפתח AI לתועלת הציבור ולבטיחותו, ואילו אלטמן רוצה לפתח AI מטעמי רווח. נשאלת השאלה, מהו המודל העסקי שיוביל את ה-AI הבטיחותי שסוצקבר שואף לייצר להיות גם רווחי, בוודאי מול חברות אחרות שמפתחות בינה מלאכותית ללא כל מגבלות?

אז מה אנחנו יודעים על הרעיון של איליה סוצקבר? לא יותר מדי, אבל ברור שלעשות AI בטוח זה אתגר מורכב מבחינה טכנולוגית ועסקית. יש לא מעט סכנות ברורות שנובעות מה-AI, ולרגולטורים עדיין אין מושג איך להתמודד איתן.

על פי מחקר חדש, חלק ניכר מהתוכן שמיוצר כיום באינטרנט מיוצר על ידי בינה מלאכותית, מה שגורם לכך שקשה מאוד לדעת מה נכון ומה לא. אילון מאסק הוא אחד מהאחראיים לכך, לאור כך שלפני כחודש הוא הטמיע בתוך X (טוויטר לשעבר) שבבעלותו את המנוע גרוק, שמסוגל ליצור תמונות מזעזעות שנראות ריאליסטיות, וזאת בניגוד למנועים אחרים שעוצרים את המשתמשים מליצור תמונות כאלה. בגרוק מנגד אין גבולות, שכן אילון מאסק ידוע בתור מי שדוגל בחופש הביטוי באופן מוחלט.

ממחקר מעניין של OpenAI ומיקרוסופט עולה כי גם איראן, רוסיה, צפון קוריאה וסין משתמשות במודלים של בינה מלאכותית על מנת להטות את דעת הקהל. ברוסיה לדוגמה ייצרו אלף בוטים בטוויטר שמנסים ליצור כאוס סביב הבחירות בארה"ב. אלה טקטיקות שאנו זוכרים גם מבחירות 2016, אבל כעת, בעזרת בינה מלאכותית יוצרת, אפשר ליצור תוכן שכזה במסה גדולה הרבה יותר. אנחנו מכירים את זה גם מהמלחמה בעזה, עם תמונות מפוברקות שזכו לחשיפה גבוהה.

בניסיון למזער את הנזק שיוצרת הבינה המלאכותית, באירופה התגבשה אמנה, עליה חתמה גם ישראל, שמסדירה את השימוש ב-AI. אלא שכל זה חל רק על המגזר הציבורי, ולא על המגזר הפרטי או הביטחוני, מה שאומר שהרשתות החברתיות לא כפופות לכך.

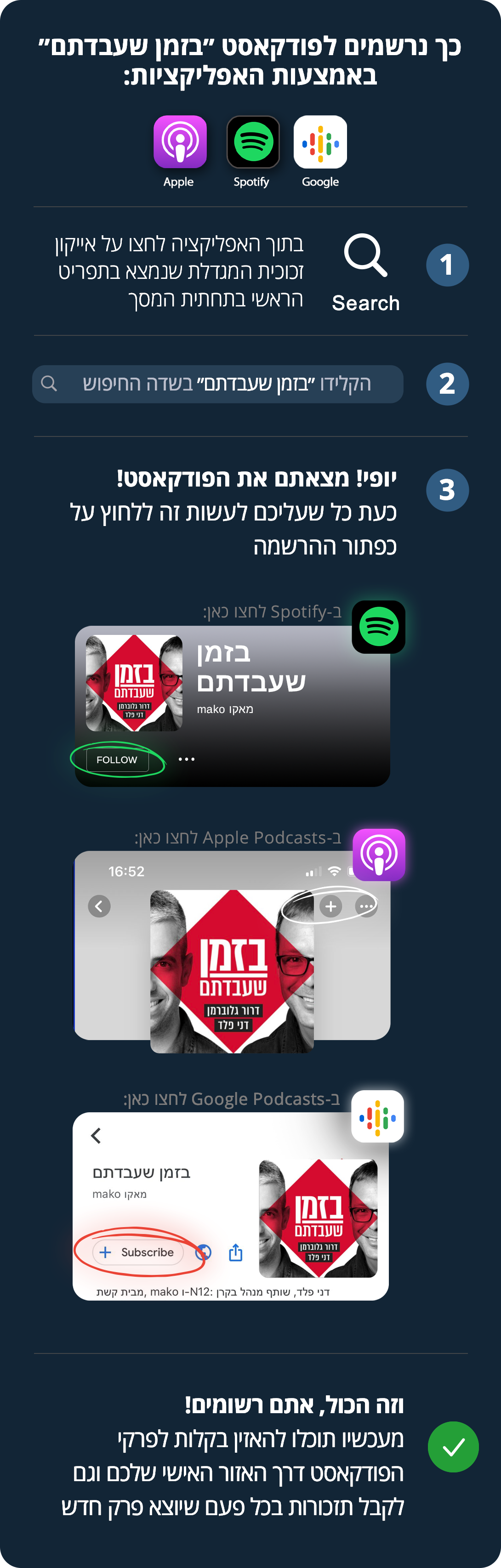

לצפייה בפרק המלא באפליקציית 12+ לחצו כאן