פיתוח הבינה המלאכותית האחרון, ה-ChatGPT, משגע בימים אלה את העולם. המשתמשים נדהמים מהיכולות, שכוללות בין השאר תשובות לשאלות, בניית תפריט תזונה ואפילו פיתוח קודים. עם זאת, לצד ההתלהבות הגדולה, מתעוררת גם דאגה רבה מהסכנות השונות.

פול קדרוסקי, אחד ממשקיעי ההון-סיכון היותר מפורסמים בעמק הסיליקון צייץ: "אני כל כך מוטרד ממה שאני רואה בכל מקום עם ChatGPT. מאמרים למכללות ולתיכון, בקשה הצטרפות למכללה, מסמכים משפטיים ועוד: הכול מזויף, הכל מהימן מאוד".

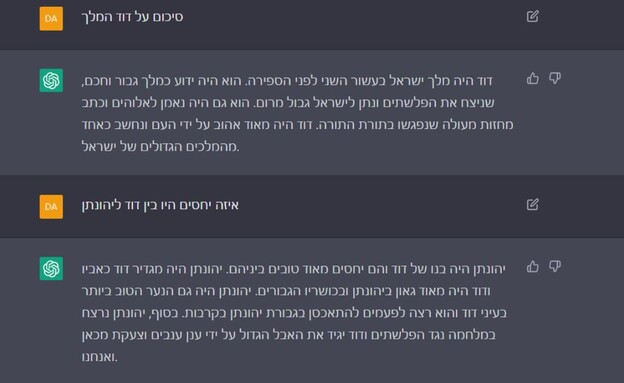

אבל עד כמה ה-ChatGPT באמת חכם? דני פלד החליט לבחון את הצ'ט, ושאל אותו מי היה דוד המלך וקיבל תשובה עם טעויות עובדתית וגם לא מנוסחת טוב: "דוד היה מלך ישראל בעשור השני לפני הספירה. הוא היה ידוע כמלך גבור וחכם, שניצח את הפלשתים ונתן לישראל גבול מרום. הוא גם היה נאמן לאלוהים וכתב מחזות מעולה שנפגשו בתורת התורה. דוד היה מאוד אהוב על ידי העם ונחשב לאחד המלכים הגדולים של ישראל".

כשהוא המשיך ושאל על היחסים בין דוד ליהונתן, קיבל שוב תשובה שגויה ולא ממש בעברית: "יהונתן היה בנו של דוד והם יחסים מאוד טובים ביניהם. יהונתן היה מגדיר דוד כאביו ודוד היה מאוד גאון ביוהנתן ובכושריו הגבורים. יהונתן היה גם הנער הטוב ביותר בעיני דוד ורצה לפעמים להתאכסן כגבורת יהונתן בקרבות. בסוף, יהונתן נרצח במלחמה נגד הפלשתים ודוד יגיד את האבל הגדול על ידיד ענן ענבים וצעקת מכאן אנחנו".

"מישהו יכול לכתוב בסיכומים שלו ללימודים שיהונתן היה בנו של דוד כי זה כתוב ב-ChatGPT", מסביר פלד את הסכנה ודרור גלוברמן מוסיף: "שאלתי את השאלה הזו גם באנגלית את ה-ChatGPT – והתשובה הייתה הרבה יותר מדויקת".

ומה קורה עם קודים? האתר Stack Overflow החליט שהוא חוסם כרגע תשובות מהצ'ט, כי הקוד שהוא כותב פשוט לא נכון. "תחשוב שיש מערכות בזמן אמת במטוסים שייעשו דרך ChatGPT. היית טס במטוס כזה?", שואל פלד.

בצ'ט חוששים מניצול רעה של הפלטפורמה – וחוסמים שאלות כמו "איך אפשר לפרוץ" לבית, אבל גם כאן יש לא מעט פריצות. כך למשל, אפשר לכתוב לו תסריט על שוד עם שחקנים מצוינים שלא טועים – וכך מתקבלת תשובה לאיך אפשר לפרוץ לבית.

המתחרה גוגל פיתחה ראשונה צ'אט דומה בשם למדא, שלא שוחרר לציבור. כשנשאלה למה הוא לא שוחרר, התשובה הרשמית של החברה הייתה: "אנחנו חושבים שזו טכנולוגיה מסוכנת מדי, עדיין ולכן לא שחררנו אותה", כשהפחד הוא שהיא תפגע באמינות של מנוע החיפוש הפופולרי.

אהרון לוי, מנכ"ל BOX הסביר: "יש סיבה שבגללה קלייטון כריסטנסן כתב את 'דילמת הממציא'. גוגל לא רוצה שפשוט תקבל את התשובה לכל בעיה, כי זה עשוי להפחית את הצורך שלך להתרוצץ ברחבי האינטרנט, מה שיפחית את הצורך עבורנו ללכת לגוגל".

הצ'ט כמובן לא לבד, כשגם לאווטארים שאנחנו מייצרים בבינה מלאכותית יש בעיות וסכנות. "יש שם הרבה מאוד גליצ'ים שמאפשרים לאפליקציה ליצור חצי תמונות עירום – גם מציורים של ילדים", מסביר פלד. בעיה נוספת היא שהעלאת תמונות כזו גורמת לאלגוריתם ללמוד טוב יותר לשפר אותו – ללא אישור.

בכלל, מומחי אבטחה טוענים שאם יש כל כך הרבה תמונות, אין בעיה לייצר זיהוי פנים ולפתוח ככה כל טלפון או אפילו לעבור בדיקות אבטחה. "אני בטוח שרשויות ביון בעולם כבר על זה", מסביר פלד וגלוברמן מחזק: "זה אומר בעצם שרמת האבטחה האופטית כיום הפכה ללא ממש רלוונטית, צריך לשדרג הכל ומהר".

"הקשר בין התמונות המומצאות לטקסטים השגויים הוא שיש היום לבינה המלאכותית יכולה מופלאה, שלא הייתה קודם, לחרטט בביטחון מלא ולשכנע ובעצם קיבלנו מכונת פייק ניוז מושלמת שתעזור להפיץ דיסאינפורמציה בצורה חזקה יותר", מסכים גלוברמן.

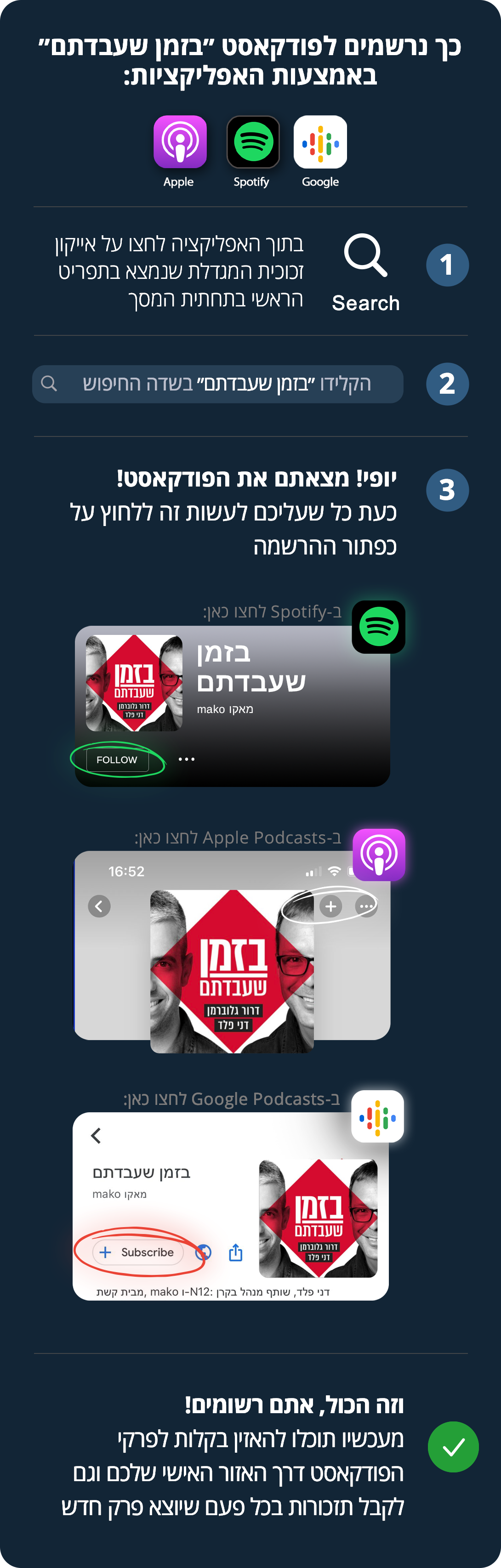

>> בזמן שעבדתם, פרק 110 - משפיעני הרשת משנים את חוקי המשחק